Wenn du schon einmal ein großartig aussehendes Charakterbild erstellt hast und dann an die Wand gestoßen bist – „Okay, aber wie bringe ich sie dazu, sich jedes Mal gleich zu bewegen?“ – dann bist du genau die Person, für die Motion Control entwickelt wurde.

Text-Prompts allein können anständige Videos erzeugen… aber sie sind nicht gut in Wiederholbarkeit. Ein Lauf liefert einen flüssigen Gang; der nächste Lauf zeigt einen anderen Gang, ein anderes Gesicht und manchmal sogar eine andere Person. Motion Control behebt das, indem es dir erlaubt, Bewegungen aus einem echten Referenzclip zu übernehmen und auf deinen Charakter anzuwenden.

In dieser Anleitung führen wir dich durch einen benutzerfreundlichen Workflow mit Kling 2.6 zur Erstellung von Charakterbewegungen, und ich erkläre, warum kling 2.6 motion control die bessere Wahl für Motion Control ist (im Vergleich zu higgsfield motion control), wenn dein Hauptziel eine saubere Bewegungstransfer und konsistente Identität ist. Zum Abschluss zeigen wir, warum die Durchführung dieses Workflows auf Flux Pro AI den gesamten Prozess einfacher macht.

Was macht Motion Control eigentlich?

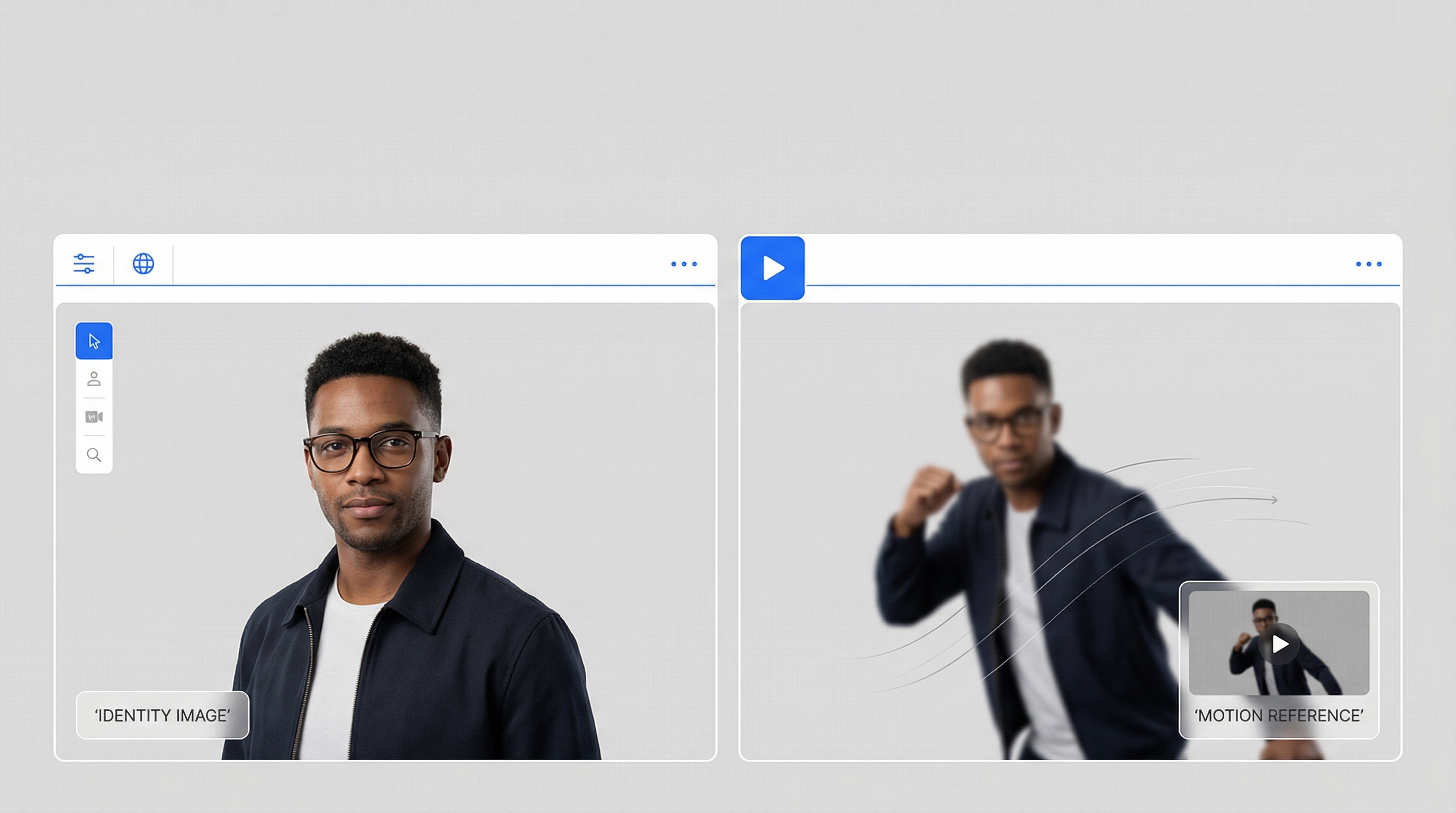

Motion Control ist im Grunde genommen eine Rezeptur mit zwei Eingaben:

- Ein Charakterbild (Identität: Gesicht, Outfit, Silhouette)

- Ein Bewegungsreferenzvideo (Bewegung: Gestik, Gehen, Tanzrhythmus)

Der Generator versucht, die Identität stabil zu halten, während er die Bewegung aus dem Referenzvideo übernimmt.

Deshalb fühlt sich Motion Control so „Creator-orientiert“ an. Du kannst eine Content-Serie darum herum aufbauen:

- derselbe Charakter

- jede Woche neue Bewegung

- konsistentes Aussehen

Und weil die Bewegung an einen echten Clip gebunden ist, wirken die Ergebnisse oft glaubwürdiger – besonders für Social Content.

Die zwei Tools: Higgsfield vs. Kling (Wobei jedes am besten ist)

Du wirst Leute Higgsfield und Kling vergleichen sehen, weil sie oft für ähnliche „Bild-zu-Video“-Ziele eingesetzt werden, aber sie glänzen in unterschiedlichen Bereichen.

Higgsfield: polierter Look, professionelles Flair

Wenn Menschen über Higgsfield als Bild-zu-Video-Option sprechen, ist der Eindruck meist sauber, cinematisch und produktionsfreundlich – ideal, wenn dir Ästhetik und allgemeine Videoerzeugung wichtig sind.

Wenn du es auf Flux Pro ausprobieren möchtest, hier die Modellseite:

- Higgsfield AI (Flux Pro): https://fluxproweb.com/model/higgsfield-ai/

Kling: Treue beim Bewegungstransfer (der Motion-Control-Spezialist)

Klings Motion-Control-Workflow basiert auf dem Konzept der Bewegungsreferenz. Das ist der entscheidende Unterschied: Es agiert wie ein Bewegungs„Mapper“, nicht nur ein Video-Generator.

Die Flux Pro Kling-Seite findest du hier:

- Kling Motion Control (Flux Pro): https://fluxproweb.com/model/kling-motion-control/

Und in diesem Artikel verwenden wir diese Schlüsselwörter exakt wie gewünscht:

Warum Kling 2.6 besser ist als Higgsfield für Motion Control

Angenommen, dein Ziel ist „den gleichen Charakter zuverlässig dieselbe Art von Bewegung machen zu lassen“. Dann gewinnt Kling 2.6 in der Regel.

Hier der creator-zentrierte Blick darauf:

1) Bewegungsreferenz ist das Haupt-Highlight

Bei Motion-Control-Workflows ist die größte Variable, wie genau das Modell dem Referenzclip folgt – Timing, Haltung, Gestenrhythmus und die gesamte Energie.

Kling 2.6 ist exakt dafür entwickelt worden.

2) Die Identität bleibt bei Bewegung besser erhalten

Bewegung ist der Punkt, an dem viele Modelle anfangen zu wackeln:

- Gesicht driftet

- Hände „schmelzen“

- Körperproportionen verschieben sich

Klings Fokus auf Motion Control macht es in der Regel einfacher, durch Anpassung der Bewegungsreferenz (anstatt durch „Prompt-Ringen“) zu einem stabilen Ergebnis zu gelangen.

3) Iteration läuft schneller für Serienersteller

Wenn du Kurzform-Content erstellst, willst du keinen Workflow, der sich wie ein Wissenschaftsexperiment anfühlt.

Klings größter Vorteil ist, wie einfach dieser Ablauf ist:

- Identitätsbild behalten

- Bewegungsreferenz tauschen

- generieren

- das Beste auswählen

Diese Schleife ist das Rückgrat jeder skalierbaren Motion-Content-Pipeline.

Die 2-Minuten-Vorbereitung, die 80 % der seltsamen Artefakte verhindert

Hier die Wahrheit: Motion Control dreht sich weniger um „perfekte Prompts“ und mehr um passende Eingaben.

A) Wähle das richtige Charakterbild

Ein gutes Bild ist:

- klares Gesicht (nicht winzig)

- sichtbare Hände (keine Taschen)

- erkennbare Silhouette (keine abgeschnittenen Gliedmaßen bei Ganzkörperbewegungen)

- saubere Beleuchtung (extreme Schatten verursachen Flimmern)

Faustregel: Passe die Bildkomposition an.

- Ganzkörperbewegung → Ganzkörperbild

- Bewegung von der Taille aufwärts → Bild von der Taille aufwärts

- Nahaufnahme-Bewegung → Nahaufnahme-Bild

B) Wähle das richtige Bewegungsreferenzvideo

Gute Bewegungsreferenzen sind:

- stabile Kamera

- klares Subjekt

- ähnlicher Winkel wie dein Charakter

- moderate Geschwindigkeit

Wenn du „virale Bewegungen“ willst, fang nicht mit der verrücktesten Choreografie an. Beginne mit etwas Einfachem, das du als wiederholbares Format posten kannst:

- zum Kamera gehen

- winken + lächeln

- zeigen + reagieren

- kleiner Tanzgroove

Schritt-für-Schritt-Workflow auf Flux Pro AI

Dies ist der praktische Workflow, dem du heute folgen kannst – und für Motion Control empfehle ich, direkt mit Kling zu starten.

Schritt 1: Öffne das Modell, das du wirklich für Motion Control verwenden willst

Starte hier:

Das ist der klarste Weg, wenn dein Ziel treuen Bewegungstransfer und wiederholbare Ergebnisse sind.

Schritt 2: Lade dein Identitätsbild hoch

Wähle das sauberste Identitätsbild, das du hast. Wenn du eine Serie baust, halte eine kleine „Identitätsbibliothek“ von 3–5 konsistenten Bildern desselben Charakters bereit, um schnell testen zu können.

Checkliste:

- Gesicht ist klar und groß genug

- Hände/Arme sind nicht stark verborgen

- Bildausschnitt passt zur Bewegungsreferenz (Ganzkörper ↔ Ganzkörper, Nahaufnahme ↔ Nahaufnahme)

Schritt 3: Lade dein Bewegungsreferenzvideo hoch

Passe den Bildausschnitt an und halte die Kamera stabil. Je sauberer die Bewegungsreferenz, desto weniger muss das Modell raten.

Beste Starter-Bewegungen:

- zum Kamera gehen

- winken + lächeln

- zeigen + reagieren

- langsamer Tanzgroove

Schritt 4: Nutze ein kurzes Prompt für den Stil, nicht für die Bewegung

Das ist der größte Anfängerfehler: die Choreografie im Prompt beschreiben.

- Schreibe keinen Absatz über die Bewegung.

- Die Bewegung kommt bereits aus deinem Referenzvideo.

Dein Prompt sollte steuern:

- Beleuchtung

- Umgebung

- Realismusgrad

- Kamerastimmung

Copy/Paste-Promptmuster:

Prompt A (Social-Influencer-Flair):

Helles Tageslicht, Handykamera-Look, Straßenhintergrund, natürliche Mimik, realistische Hauttextur, saubere Details.

Prompt B (cinematisches Flair):

Cinematischer Shot, weiches Hauptlicht, geringe Tiefenschärfe, realistische Stofffalten, dezentes Filmkorn.

Prompt C (Studio-Flair):

Studiobeleuchtung, sauberer nahtloser Hintergrund, scharfe Details, sanfte Kamerabewegung, scharfer Fokus.

Schritt 5: Generiere und bewerte die richtigen Dinge

Überprüfe bei deinem Output diese vier Bereiche:

- Gesichts-Stabilität

- Hände und Finger

- Bodenkontakt der Füße (kein Gleiten)

- Hintergrundflimmern

Schritt 6: Iteriere wie ein Creator (die schnelle Schleife)

Wenn etwas nicht stimmt, ändere die Eingabe, die es kontrolliert:

- Gesicht driftet → besseres Identitätsbild + ruhigere Kopfbewegung als Referenz

- Hände sehen komisch aus → langsamere Handbewegungsreferenz + weniger Verdeckung

- Hintergrundverzerrung → stabilere Kamera + einfacherer Szenen-Prompt

Du erhältst in der Regel schneller einen „postfähigen“ Clip, wenn du die Bewegungsreferenz tauschst, statt Prompts umzuschreiben.

Wie du „viral-taugliche“ Bewegungsformate baust

Viral bedeutet nicht immer „große Choreografie“. Oft bedeutet es wiederholbar.

Hier drei einfache Formate, die skalieren:

1) Wöchentliche Bewegungsserie

- gleicher Charakter

- jede Woche neuer Bewegungsclip

- gleicher Bildausschnitt

Das ist der einfachste Weg, eine Kontoinidentität aufzubauen.

2) Markenfreundliche Gesten

Wenn du Werbe- oder Markencontent machst:

- auf Produkt zeigen

- auf Texteinblendungen reagieren

- Requisite halten

- zur Kamera wenden

Halte Hintergründe sauber und Bewegungen moderat.

3) Influencer-Style-Kurzclips

Hier die gewünschte keyword-verlinkte Erwähnung:

Gute Influencer-Bewegungen sind simpel:

- zeigen

- nicken

- kleiner Tanzgroove

- „zurückblicken und lächeln“

- lockerer Gang

Diese erzeugen eine glaubwürdige Stimmung, ohne das Modell mit komplexer Gliedmaßenakrobatik zu überfordern.

Fehlerbehebung: Die 6 Fixes, die du ständig nutzen wirst

Wenn etwas schiefläuft, liegt es fast immer an einem von drei Dingen: (1) falscher Bildausschnitt, (2) zu chaotische Bewegungsreferenz oder (3) der Prompt widerspricht der Referenz. Nutze die folgenden Lösungen als Checkliste.

1) Gesicht driftet

So sieht das aus: das Gesicht verändert sich subtil, Augen/Kiefer verschieben sich oder die Identität „rutscht“ mittendrin.

Versuche (in dieser Reihenfolge):

- Verbessere das Identitätsbild: schärfer, frontale Perspektive, größeres Gesicht im Bild, saubere Beleuchtung

- Beruhige die Bewegungsreferenz: weniger Kopfbewegungen, weniger Unschärfe, stabilere Kamera

- Verankere deinen Prompt: kurz halten; eine stabilisierende Zeile hinzufügen wie „konstantes Gesicht, natürliche Hautstruktur“

Schneller Tipp: Wenn die Bewegungsreferenz Ganzkörper zeigt, das Identitätsbild aber Nahaufnahme ist (oder umgekehrt), steigt die Drift-Wahrscheinlichkeit stark.

2) Hände sehen komisch aus

So sieht das aus: geschmolzene Finger, flimmernde Handflächen, merkwürdige Gesten.

Versuche:

- Wechsle zu einer langsamen Handbewegungsreferenz: langsam zeigen, winken, Positionen halten (erst mal kein Händeklatschen/Handdrehungen)

- Nutze ein Identitätsbild mit sichtbaren Händen/Unterarmen (keine Taschen, keine starke Verdeckung)

- Füge einen einfachen Prompt-Zusatz hinzu: „realistische Hände, natürliche Proportionen“

Schneller Tipp: Wenn du die Hände nicht unbedingt brauchst, gestalte die Bewegung so, dass die Hände näher am Körper bleiben.

3) Fußgleiten

So sieht das aus: der Charakter „eisläuft“ beim Gehen oder die Füße schweben über dem Boden.

Versuche:

- Nutze eine Bewegungsreferenz mit gut sichtbaren Fußauftritten (klare Schuhe + sichtbarer Bodenkontakt)

- Halte die Kamera stabil und den Boden sichtbar (unruhige Bodentexturen verschlimmern das Gleiten)

- Optionaler Prompt-Zusatz: „stabile Haltung, klarer Bodenkontakt“

4) Hintergrund verzerrt sich

So sieht das aus: Wände biegen sich, Hintergründe wabern, die Szene wirkt wie Gummi.

Versuche:

- Prompt für Stabilität: „sauberer Hintergrund“ oder „nahtloser Studiohintergrund“

- Wähle stabilere Bewegungsreferenzaufnahmen (weniger Wackeln/Zoomen/Pannen)

- Reduziere die Hintergrundkomplexität (Menschenmengen, Text, Muster), bis der Charakter stabil ist

Schneller Tipp: Sperre den Charakter zuerst auf einen einfachen Hintergrund und „upgradiere“ die Umgebung erst in späteren Durchläufen.

5) Zittern

So sieht das aus: mikroskopisches Zittern des Körpers, ruckelige Bewegungen, Frame-zu-Frame-Popps.

Versuche:

- Vermeide drehintensive Tänze und plötzliche Richtungswechsel, bis du eine stabile Basis hast

- Nutze hochwertigeres Bewegungsmaterial (weniger Kompression, klareres Subjekt, gleichmäßige Beleuchtung)

- Halte Prompts kurz – lange, stillastige Prompts können das Zittern verstärken

6) Sieht zu „KI-mäßig“ aus

So sieht das aus: plastische Haut, unheimliche Gesichtsausdrücke, überstilisierte Beleuchtung.

Versuche:

- „natürliche Beleuchtung, realistische Texturen, dezente Details“

- Verwende weniger Stil-Adjektive (wähle einen Vibe: Social oder Cinematic oder Studio)

- Vereinfache Hintergründe, bis der Charakter stabil ist, und baue die Komplexität stufenweise wieder ein

Schneller Tipp: „Handy-Video Tageslicht“-Prompts wirken für Kurzform-Content oft glaubwürdiger als dramatische Neonbeleuchtung.

Was „Unlimited“ normalerweise bedeutet (und wie man es richtig liest)

Du wirst folgenden Begriff sehen:

Auf den meisten Creator-Plattformen bedeutet „Unlimited“ typischerweise Zugriff auf Planebene (statt eines kleinen Tageslimits), kann aber je nach Plattform noch nutzungsabhängigen Regeln unterliegen.

Die praktische Erkenntnis:

- Wenn du viele Clips renderst, wähle einen Plan, der zu deinem Volumen passt.

- Wenn du experimentierst, starte klein und skaliere, sobald dein Workflow stabil läuft.

Warum ich empfehle, das auf Flux Pro AI zu machen

Motion Control wird frustrierend, wenn dein Workflow auf mehrere Tools verstreut ist.

Flux Pro AI macht das Leben einfacher, weil du:

- dein Motion-Control-Modell an einem Ort hast

- deine Identitätsbilder und Bewegungsreferenzen organisiert hältst

- schneller iterierst, ohne Plattformen zu wechseln

Und wenn du den einfachsten „Jetzt-machen“-Weg willst, folge diesem Link:

Starte mit einem Gang oder einem Winken, sperre die Identitätsstabilität und steigere dich zu energischeren Bewegungen.

Kurzes FAQ

Welche Bewegungs-Videos funktionieren am besten?

Stabile Kamera, klares Subjekt, erkennbare Gliedmaßen, moderate Geschwindigkeit.

Kann ich Sprechen/Lippenbewegungen machen?

Ja, aber fang mit sanfter Bewegung und Nahaufnahme an. Extreme Kopfbewegungen erhöhen die Drift.

Wie behalte ich denselben Charakter über mehrere Clips?

Verwende dasselbe Identitätsbild (oder eine kleine Gruppe konsistenter Bilder) und halte den Bildausschnitt konstant.

Wie lang sollte der Prompt idealerweise sein?

Kurz. Stilrichtlinien wirken besser als erzählerische Beschreibungen bei Motion Control.

Welches ist das einfachste virale Format zum Starten?

Ein einfacher Gang zur Kamera, ein Winken oder ein Zeigen-und-Lächeln-Clip bei hellem Tageslicht.